算力挑战催生新需求

谷歌计划推出覆盖全球的语音识别服务,然而,它遇到了一个问题:对人工智能的运算需求大大超过了现有的计算能力。这个问题让谷歌陷入了困境。为了满足全球用户对语音识别的广泛需求,所需的计算资源相当庞大。如果不能突破计算能力的限制,语音识别服务的推出可能会遇到障碍。所以,开发适用于深度学习的专用处理器芯片变得非常急迫。

在这种形势下,谷歌增加了对专用芯片的投入。他们认识到,现有的计算能力不足以满足未来人工智能业务的需求。因此,研发内部专用的深度学习处理器芯片,成为了提升计算能力的关键举措。这一举措让谷歌在人工智能领域持续保持了领先地位。

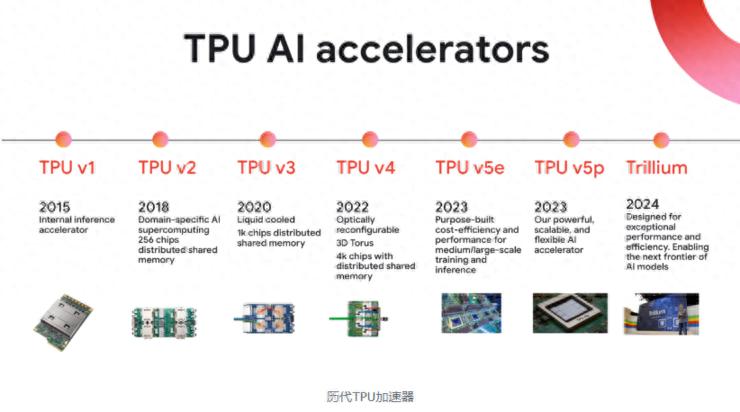

第一代TPU诞生

2015年,谷歌推出了首个TPU处理器。之后,它被应用于数据中心,支持深度学习模型的训练。这一行动标志着谷歌在算力芯片领域取得了显著进展。在实际应用中,TPU在处理深度学习任务上展现了出色的性能,为谷歌的运营提供了强大的计算能力。

谷歌机器学习硬件系统的负责人是Andy Swing,他先前预计TPU的产量不会超过一万。然而,实际生产量却大大超出了预期,达到了十万颗以上。TPU的应用领域极为广泛,不仅包括广告、搜索和语音等传统行业,甚至像AlphaGo和自动驾驶这样的尖端领域也开始使用它。这充分展示了TPU的强大功能及其广泛的潜在应用领域,同时也让人们认识到它在人工智能这一领域内蕴藏着巨大的发展潜力。

市场反响热烈

TPU的问世再次唤起了大家对计算机架构的兴趣。随后几年,众多初创公司如春笋般冒出,每年融资总额几乎达到20亿美元,创新思维和技术层出不穷。这些迹象都显示出TPU促进了行业的变革,给计算机架构领域带来了新的生机,同时也体现了市场对其的高度评价。

TPU使得谷歌成为继英伟达之后的又一关键算力提供者。目前,英伟达在人工智能芯片领域占据领先。然而,TPU的进步使得谷歌具备了与英伟达抗衡的实力。通过TPU,谷歌在算力市场确立了地位,同时也加强了其在人工智能领域的优势。

苹果的应用实例

2024年7月,苹果公布了其在模型训练中运用TPU芯片的相关信息。他们采用了2048块TPUv5p芯片,专门对设备端的AFM模型进行训练。该模型的参数量高达27.3亿。此外,苹果还使用了8192块TPUv4芯片,用于训练服务器端的AFM大规模模型。这些数据充分展示了TPU在人工智能领域的广泛运用。

苹果作为业界领军企业,选择了TPU来训练模型,这无疑是对其强大性能的充分认可。此举同时也向公众传达了TPU在应对大规模人工智能模型训练时的卓越能力。由此看来,未来将会有更多企业对TPU产生兴趣并采纳它。展望未来,人工智能芯片市场的竞争将会愈发激烈。

人才流动故事

2016年,TPU v1芯片正式发布,Palihapitiya对其创新性给予了高度评价。他深信,这项技术将为Facebook、Amazon、Tesla等企业和政府部门带来巨大变革,助力它们通过机器学习和计算机技术达成过去难以达成的目标。因此,他着手开展人才招募,对谷歌TPU领域的工程师进行了详尽的人才评估。

在短短一年半的时光里,Palihapitiya成功吸纳了谷歌芯片团队的8位成员。在这其中,Jonathan Ross和软件工程师Doug Wightman的作用尤为关键。他们携手创立的Groq公司,很快就在AI芯片领域崭露头角,成为了行业的佼佼者。企业间的人才流动引起了广泛的公众关注,其影响之强烈,超出了人们的预期。

TPU受认可原因

TPU团队在业内享有盛誉,这主要归功于他们在谷歌研发TPU过程中积累的工程技术。团队成员拥有坚实的研发基础,对从芯片设计到实际应用的整个过程了如指掌,并且能够迅速应对研发过程中出现的各种难题。

TPU这类芯片专为提升机器学习和神经网络性能而打造,正好迎合了当前市场的迫切需求。人工智能领域发展迅猛,机器学习和神经网络的应用越来越普遍,对芯片的计算速度和性能有了更高要求。TPU正好能够满足这些需求,因此赢得了市场的广泛认可。

关于TPU在人工智能芯片领域的表现,是否能够超越英伟达,大家有何见解?欢迎在评论区发表你的看法。另外,别忘了点赞和分享这篇文章!